Model Context Protocol (MCP): Cosa sono, e perché sono importanti per portare le AI in azienda in modo efficace.

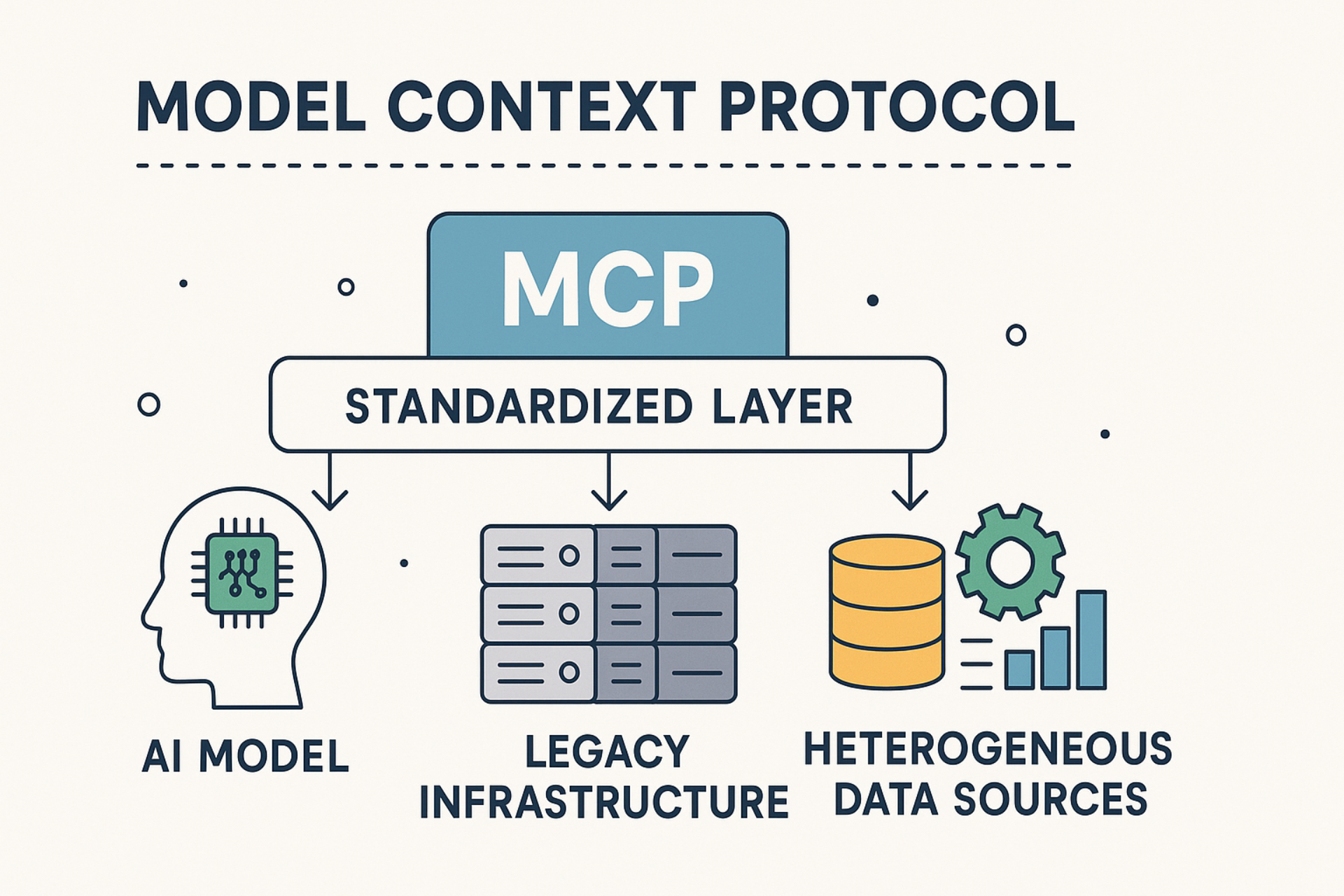

Il Model Context Protocol (MCP) nasce per rispondere all’esigenza delle imprese di integrare modelli di intelligenza artificiale con infrastrutture legacy e fonti di dati eterogenee. MCP è una possibilità di avere un layer standardizzato per abilitare questa integrazione in modo scalabile e strutturato.

È stato introdotto da Anthropic nel 2024 come modello standard aperto pensato per stabilire un’interfaccia comune tra modelli linguistici e risorse computazionali esterne. MCP può essere metaforicamente assimilato a una porta USB-C: un’interfaccia unica per connettere l’AI a qualsiasi ambiente, indipendentemente dalla specificità dei sistemi.

Problema M×N: il punto di partenza

Prima dell’introduzione di MCP, ogni applicazione AI doveva creare integrazioni personalizzate per ogni strumento o servizio che voleva utilizzare. Questo approccio frammentato creava quello che gli sviluppatori chiamano il “problema M×N”: se si hanno M diverse applicazioni AI e N diversi strumenti, potenzialmente si dovevano costruire M×N diverse integrazioni. Il risultato era un ecosistema caotico, con duplicazione degli sforzi, implementazioni inconsistenti e costi di manutenzione elevati.

L’Architettura di MCP

Il Model Context Protocol si basa su un’architettura elegante e straightforward che comprende quattro componenti principali:

- Host MCP: Rappresentano le applicazioni AI (come Claude Desktop, VS Code, o altri strumenti AI) che vogliono accedere a risorse esterne. Gli host coordinano l’intero sistema e gestiscono le interazioni con i modelli linguistici.

- Client MCP: Fungono da ponte tra gli host e i server, stabilendo connessioni one-to-one e gestendo la comunicazione bidirezionale.

- Server MCP: Sono programmi leggeri che espongono specifiche funzionalità, dati o strumenti ai modelli AI. Ogni server può fornire accesso a database, API, file system, o qualsiasi altra risorsa.

- Protocollo Base: Definisce le regole di comunicazione tra tutti questi componenti, basandosi su JSON-RPC e ispirandosi al Language Server Protocol (LSP) che ha standardizzato il supporto per i linguaggi di programmazione negli IDE.

A Cosa Serve il Model Context Protocol: Funzionalità e Casi d’Uso

Il Model Context Protocol risolve problemi concreti e tangibili che le organizzazioni affrontano quotidianamente nell’implementazione di soluzioni AI. La sua utilità si manifesta attraverso tre primitive fondamentali che abilitano interazioni ricche e dinamiche.

Le Tre Primitive di MCP

Il protocollo si articola attorno a tre componenti essenziali che definiscono come l’AI può interagire con il mondo esterno:

- Prompts: Sono template predefiniti o istruzioni che guidano le interazioni dei modelli linguistici. Rappresentano workflow completi controllati dall’utente e possono essere invocati per eseguire sequenze specifiche di azioni.

- Resources: Costituiscono dati strutturati o contenuti che forniscono contesto aggiuntivo al modello. Funzionano come endpoint GET in un’API REST, fornendo dati senza effetti collaterali e sono controllati dall’applicazione.

- Tools: Sono funzioni eseguibili che permettono ai modelli di performare azioni o recuperare informazioni. Rappresentano l’esecuzione di codice arbitrario e sono controllati dal modello stesso.

Perché il Model Context Protocol è importante per lo sviluppo delle AI nelle imprese

L’importanza di MCP per le imprese va ben oltre la semplice standardizzazione tecnica. Rappresenta un cambio di paradigma che affronta direttamente le sfide più pressanti che le organizzazioni affrontano nell’adozione dell’AI a livello enterprise.

Risoluzione del Problema della Frammentazione

Le organizzazioni moderne operano in ecosistemi tecnologici complessi, con dozzine o centinaia di sistemi diversi che devono comunicare tra loro. Prima di MCP, ogni integrazione AI richiedeva sviluppo custom, creando un labirinto di connettori difficili da mantenere. MCP trasforma questo scenario caotico in un approccio sistematico e scalabile.

Il protocollo permette alle aziende di costruire una volta e integrare ovunque. Invece di sviluppare connector specifici per ogni combinazione AI-sistema, le organizzazioni possono implementare server MCP per i loro sistemi chiave e utilizzarli con qualsiasi applicazione AI compatibile. Questo approccio riduce drasticamente i costi di sviluppo e manutenzione, accelerando il time-to-market per nuove soluzioni AI.

Sicurezza e Controllo Enterprise-Grade

Una delle preoccupazioni principali delle imprese nell’adozione dell’AI è la sicurezza dei dati e il controllo degli accessi. MCP affronta queste preoccupazioni attraverso un approccio multi-livello alla sicurezza che è stato significativamente rafforzato negli aggiornamenti del 2025.

La specifica di autorizzazione più recente (versione 2025-06-18) implementa OAuth 2.1 come standard obbligatorio, garantendo autenticazione robusta e gestione granulare dei permessi. Questo significa che le aziende possono mantenere il controllo completo su chi può accedere a quali dati e quando, integrando MCP con i loro sistemi di identity management esistenti.

Inoltre, MCP supporta il principio di “data locality“, permettendo ai server di funzionare localmente sui sistemi aziendali. I dati sensibili non devono mai lasciare l’infrastruttura aziendale, mentre l’AI può comunque accedervi attraverso il protocollo standardizzato.

Scalabilità e Performance

L’architettura di MCP è progettata per scalare dalle implementazioni proof-of-concept alle deployment enterprise su larga scala. Il supporto per multiple modalità di trasporto – da STDIO per sviluppo locale a HTTP streamable per server remoti – permette alle organizzazioni di scegliere l’approccio più appropriato per le loro esigenze specifiche.

La capacità di “sampling” introdotta nelle versioni recenti è particolarmente rilevante per le imprese. Invece di richiedere a ogni server MCP di gestire le proprie chiavi API e SDK AI, i server possono utilizzare le subscription AI esistenti dell’organizzazione. Questo centralizza la gestione delle licenze, migliora la sicurezza e riduce i costi operativi.

Interoperabilità e Vendor Independence

MCP garantisce che le organizzazioni non rimangano “bloccate” con un singolo vendor di AI. Essendo uno standard aperto, qualsiasi fornitore può implementare il supporto MCP, permettendo alle aziende di cambiare o combinare diverse soluzioni AI senza dover riscrivere le integrazioni esistenti.

Questa flessibilità è cruciale in un mercato AI in rapida evoluzione, dove nuovi modelli e fornitori emergono costantemente. Le aziende possono investire con fiducia nell’ecosistema MCP, sapendo che i loro investimenti in integrazione non diventeranno obsoleti con i cambiamenti tecnologici.

Implementazione tecnica e considerazioni architetturali

L’implementazione di MCP in ambiente enterprise richiede una pianificazione attenta e considerazioni architetturali specifiche che vanno oltre la semplice adozione del protocollo.

Strategie di Deployment

Le organizzazioni hanno diverse opzioni per implementare MCP, ciascuna con i propri vantaggi e trade-off:

- Deployment Locale: I server MCP girano direttamente sui sistemi aziendali, utilizzando STDIO come modalità di trasporto. Questo approccio offre il massimo controllo e sicurezza, ma richiede gestione locale dell’infrastruttura.

- Deployment Ibrido: Combina server locali per dati sensibili con server remoti per servizi meno critici. Questa strategia bilancia sicurezza e convenience, permettendo alle organizzazioni di ottimizzare per caso d’uso specifico.

- Deployment Cloud-Native: Utilizza server MCP hostati in cloud con autenticazione OAuth robusta. Offre scalabilità massima e riduce l’overhead operativo, ma richiede fiducia nei provider di servizi cloud.

Integrazione con Sistemi Legacy

Una delle sfide più significative per le imprese è l’integrazione di MCP con sistemi legacy esistenti. Il protocollo è sufficientemente flessibile da permettere wrapper attorno a API esistenti, database legacy e sistemi proprietari.

Le organizzazioni possono sviluppare server MCP che fungono da “traduttori”, convertendo chiamate MCP in protocolli legacy specifici. Questo approccio permette di modernizzare gradualmente l’infrastruttura senza richiedere migrazioni massive o interruzioni operative.

Strategie di implementazione: L’approccio graduale e non sostituire tutto subito

Sostituire sistemi legacy è come demolire e ricostruire la sede aziendale mentre continui a lavorarci dentro. È rischioso, costoso, e spesso non necessario se l’obiettivo è solo far “parlare” i sistemi con l’AI.

L’Approccio “Ponte”

Fase 1 – Solo Lettura (Rischio Zero)

Iniziamo permettendo all’AI di “leggere” dai sistemi legacy senza modificare nulla:

- L’AI può rispondere a domande sui dati esistenti

- Nessun rischio di danneggiare o alterare i sistemi operativi

- I processi business continuano esattamente come prima

Esempio Pratico: Un’assicurazione permette all’AI di leggere le polizze storiche per rispondere istantaneamente a domande come “Quanti sinistri ha avuto questo cliente?” o “Qual è la storia assicurativa di questa famiglia?”

Fase 2 – Operazioni Limitate (Rischio Controllato)

Permettiamo all’AI di eseguire operazioni semplici e reversibili:

- Creazione di report automatici

- Aggiornamenti non critici

- Operazioni con approval umano

Esempio Pratico: L’AI può creare automaticamente preventivi assicurativi consultando i sistemi di rischio, ma un umano deve sempre approvare prima dell’invio al cliente.

Fase 3 – Integrazione Completa (Massimo Valore)

L’AI può operare autonomamente su processi ben definiti:

- Automazione di workflow completi

- Decisioni automatiche entro parametri prestabiliti

- Operazioni in tempo reale

Il Futuro di MCP e l’Evoluzione dell’Ecosistema AI

L’adozione rapida di MCP nel 2025 indica una tendenza chiara verso la standardizzazione nell’ecosistema AI, ma questo è solo l’inizio di una trasformazione più ampia, con nuove funzionalità e capacità che emergono costantemente:

- Multi-Agent Coordination: Le future versioni di MCP probabilmente includeranno supporto nativo per coordinamento tra multiple istanze AI, permettendo workflow complessi che coinvolgono team di agenti specializzati.

- Real-time Collaboration: L’integrazione con piattaforme di comunicazione e collaboration tools sta creando nuove possibilità per assistenti AI che partecipano attivamente a meeting, discussioni e processi decisionali

- Edge Computing Integration: Con la crescente adozione di edge computing, MCP si sta evolvendo per supportare deployment distribuiti e sincronizzazione tra dispositivi edge e cloud.

Impatto Industria-Specifico

Diversi settori stanno adattando MCP per le loro esigenze specifiche:

- Settore Finanziario: Le istituzioni finanziarie stanno utilizzando MCP per integrare AI con sistemi di trading, risk management e compliance, creando soluzioni che rispettano rigorosi requisiti regolamentari.

- Sanità: Nel settore sanitario, MCP sta abilitando l’integrazione di AI con sistemi di cartelle cliniche elettroniche, dispositivi medicali e database di ricerca, sempre mantenendo compliance HIPAA.

- Manufacturing: L’industria manifatturiera sta sfruttando MCP per collegare AI con sistemi MES, sensori IoT e database di qualità, ottimizzando processi produttivi e manutenzione predittiva.

MCP Come catalizzatore della trasformazione AI enterprise

Il Model Context Protocol rappresenta molto più di una semplice specifica tecnica: è un catalizzatore per la trasformazione digitale che le aziende stanno vivendo nell’era dell’AI. Risolvendo il problema fondamentale dell’integrazione tra sistemi AI e dati aziendali, MCP sblocca il vero potenziale dell’intelligenza artificiale nei contesti enterprise.

Per le organizzazioni che si chiedono se e quando adottare MCP, la risposta è chiara: non si tratta più di “se” ma di “come” e “quando”. L’ecosistema sta maturando rapidamente, con supporto da parte di major player tecnologici come Microsoft, GitHub e Anthropic, e un crescente numero di strumenti e piattaforme che implementano il protocollo.

Le aziende che adottano MCP oggi si posizionano vantaggiosamente per il futuro, creando fondamenta solide per l’innovazione AI che continuerà a evolversi. Quelle che aspettano rischiano di trovarsi indietro in un mercato dove l’integrazione efficace tra AI e sistemi aziendali diventerà sempre più un fattore competitivo determinante.

MCP non è solo una tecnologia: è l’abilitatore di un futuro dove l’intelligenza artificiale è veramente integrata nel tessuto operativo delle organizzazioni, trasformando non solo come lavoriamo, ma cosa possiamo raggiungere attraverso la sinergia tra intelligenza umana e artificiale.